Read Paper 《Spatial Pyramid Pooling in Deep Convolutional Networks for Visual Recognition》

Contents

URL: https://ieeexplore.ieee.org/abstract/document/7005506

TL;DR

TPAMI 2015 经典论文。 对于不同尺寸的输入图片动态选择池化的尺寸,使得最终输出统一尺寸的特征。 比放缩和补0更好地保持了图像的原始特征。

Algorithm

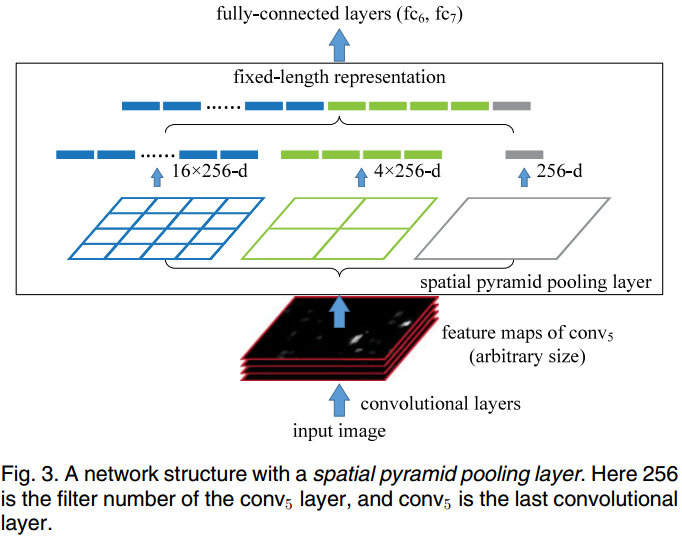

在实际场景中图片的尺寸不会像数据集那样规整,放缩、填充、滑窗等操作虽然能够固定尺寸,但都会破坏图像的原始特征。

而CNN中卷积层和池化层并不要求固定的输入输出尺寸,之所以要统一尺寸,是因为最后的全链接层尺寸恒定。

为了更好的提取原始特征,本文保持前面的卷积池化操作直接使用原始图像,在全链接层前根据之前的特征图,根据需要的输出尺寸动态计算池化窗。

即不论卷积层输出尺寸是多少,按照全链接层输入尺寸除以卷积层输出尺寸得到最后一层池化尺寸。

为了更好的兼顾大小特征,这里以4*4、2*2、1*1等目标尺寸动态池化完后,在伸展成全链接层的输入。

即不论卷积层输出尺寸是多少,按照全链接层输入尺寸除以卷积层输出尺寸得到最后一层池化尺寸。

为了更好的兼顾大小特征,这里以4*4、2*2、1*1等目标尺寸动态池化完后,在伸展成全链接层的输入。

Model

构筑模型的时候在原有模型的底层卷积和顶层全链接之间插入空间金字塔池化。

Thoughts

这种动态结构自然不适合拼batch训练和测试,除非能凑出同样尺寸的输入,或分组放缩。 这会导致作者采用的local response normalization或后来的batch normalization难以使用。 这种结构也要求输入尺寸满足前期卷积所需要的最小尺寸(比卷积核大)。

Author lvcudar

LastMod 2019-08-02